Mit den Applysia Insights ermöglichen wir Ihnen Einblicke in Ihre Assessment-Prozesse ohne langwieriges Sammeln und Auswerten von Daten. Dabei fokussieren wir uns beim ersten Release der Insights vor allem auf die Evaluation des Prozesses und der Kompetenzmodelle.

Denn genauso wichtig wie die sorgfältige Konzeption eines Assessment Centers ist die regelmäßige Evaluation. Laut DIN 33430 sollte etwa alle acht Jahre eine Evaluation der Prozesse in der Personalauswahl stattfinden. Gleichzeitig ist die Evaluation der Prozesse allerdings oftmals sehr aufwendig und wird deshalb selten durchgeführt. Daher haben wir mit den Applysia Insights eine nutzerfreundliche, intuitiveund smarte Lösung entwickelt, um einfach und effizient Prozessverbesserungen zu ermöglichen.

Benchmarks

Die Grundlage bilden automatische Benchmarks. Für jedes Kompetenzmodell kann angezeigt werden, wie die einzelnen Kompetenzen im Mittel bewertet wurden. Oder in anderen Worten: Das Kompetenzprofil der/des Durchschnitts-Kandidat*in. Gleichzeitig wird auch die Standardabweichung der Bewertungen angezeigt, um die Streuung der Werte zu visualisieren. Dies gibt also an, ob der Mittelwert dadurch zu Stande kommt, dass alle Kandidat*innen immer die gleiche Bewertung erhalten, oder ob die Bewertungen sehr unterschiedlich sind.

Schon diese Werte ermöglichen spannende Einsichten. So können bei der Beurteilung zukünftiger Kandidat*innen die Benchmarks herangezogen werden, um einschätzen zu können, wie diese im Vergleich zu anderen Kandidat*innen abgeschnitten haben. Diese Beurteilung ist wichtig, da es ja durchaus sein könnte, dass alle Kandidat*innen in einer Kompetenz auf eine Skala von eins bis fünf im Schnitt mit einer 1,5 bewertet wurden. Haben Sie nun eine*n Kandidat*in mit der Bewertung von 2,5 vor sich, so liegt diese Bewertung zwar genau in der Mitte der Skala. Sie ist aber ist im Vergleich zu der mittleren Bewertung der vorherigen Kandidat*innen schon ein überdurchschnittliche Ausprägung dieser Kompetenz.

Gleichzeitig schließt sich auch schon fast automatisch die Reflexion des Kompetenzmodells an. Vielleicht ist es ja gar nicht beabsichtigt, dass alle Kandidat*innen so “schlecht” abschneiden, und die Übung könnte angepasst werden. Dabei ist auch die Betrachtung der Standardabweichung interessant. Ist diese sehr gering, spricht das dafür, dass alle Kandidat*innen immer dieselbe Bewertung erhalten. Dies ist vor allem in Personalauswahlprozessen nur selten wünschenswert. Grund hierfür ist, dass es um die Auswahl von Kandidat*innen aus einer größeren Gruppe geht, wobei es vor allem wichtig ist, die Unterschiede der Kandidat*innen zu ermitteln.

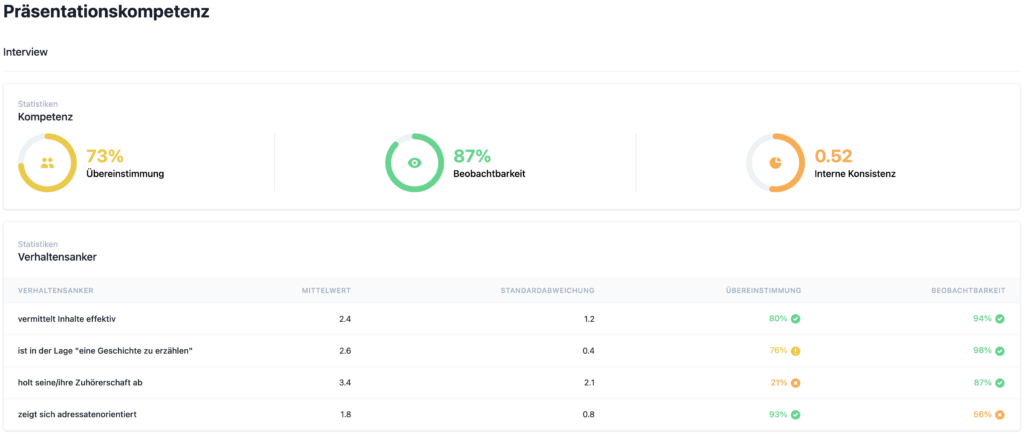

Beobachtbarkeit

Die Beobachtbarkeit gibt Aufschluss darüber, ob eine Kompetenz oder ein Verhaltensanker in einer Übung überhaupt beobachtet werden kann. Wenn z.B. die Hälfte aller Beobachter*innen einen Verhaltensanker in einer Übung nicht bewertet, könnte das dafür sprechen, dass dieser Verhaltensanker in dieser Übung oft einfach nicht (eindeutig) beobachtet werden kann. Dies ist dann ein guter Ansatzpunkt, um die Gestaltung der Übungen gezielt zu evaluieren. Bei Bedarf kann diese überarbeitet werden, um so dann die gewünschten Kompetenzen (eindeutig) zu beurteilen.

Beobachter*innen-Übereinstimmung

In den Applysia-Insights wird außerdem automatisch die Beobachter*innen-Übereinstimmung (für alle Statistiker*innen: die Intraklassen-Korrelation) berechnet. Dies gilt sowohl für die Bewertungen aller Kompetenzen als auch der Verhaltensanker.

Die Übereinstimmung ist somit ein Maß dafür, inwieweit sich die Bewertungen verschiedener Beobachter*innen, z.B. bei einem Verhaltensanker, decken. Dabei werden die Unterschiede über Kandidat*innen hinweg gemittelt um sicherzustellen, dass nur allgemeine Tendenzen und nicht individuelle Profile die Daten beeinflussen. Hat ein Anker also z.B. eine sehr geringe Übereinstimmung, könnte das ein Hinweis darauf sein, dass dieser nicht eindeutig genug formuliert ist. Das widerrum kann bei den Beobachter*innen zu Missverständnissen führen, was genau bewertet werden soll. So kann es dann passieren, dass Beobachter*innen sehr verschiedene Bewertungen abgeben, obwohl sie die/den Kandidat*in gleichzeitig beobachtet haben.

Interne Konsistenz

Die interne Konsistenz (für alle Statistiker*innen: hier Cronbach’s Alpha) hilft dabei zu beurteilen, inwieweit die Verhaltensanker dazu geeignet sind, eine zusammenhängende Kompetenz einzuschätzen. Eine hoher Wert bedeutet, dass die Anker stark miteinander zusammenhängen und somit wahrscheinlich zur Einschätzung derselben Kompetenz geeignet sind. Ist der Wert niedrig, passt vermutlich mindestens einer der Anker nicht zu den anderen. Dies kann insbesondere bei recht breiten Kompetenz-Klassen und “kombinierten” Kompetenzen wie z.B. “Strategie- und Handlungskompetenz” der Fall sein. Grundsätzlich heißen hier niedrigere Werte nicht, dass die Verhaltensanker “schlecht” sind. Vielmehr sollte man hier dann genauer hinsehen, denn es könnte ja z.B. auch durchaus Sinn ergeben, die Kompetenz aufzuteilen.

Weitere Neuerungen

Neben den Applysia Insights gibt es natürlich noch weitere neue Features und Verbesserungen:

App

- Dokumente können jetzt nach beliebigen Begriffen durchsucht werden.

- Bessere Unterstützung von langen Kompetenzen: Durch einen Klick auf den Namen von Kompetenzen in Diagrammen wird der gesamte Name der Kompetenz in einem Tooltip angezeigt.

- Im Zeitplan wird durch ein Icon angezeigt, wer Lead einer Übung ist.

- Geteilte Notizen in der Konferenz werden nun in derselben Reihenfolge angezeigt, wie die Übungen im Kompetenzmodell.

- Die App unterstützt nun auch PDFs mit ausgefüllten Formularen.

Cockpit

- Allgemeine sowie Beobachter*innen Dokumente lassen sich jetzt auch noch hinzufügen, wenn das Assessment bereits aktiv ist.

- Kandidat*innen und Beobachter*innen werden nun in der Reihenfolge angezeigt, in der sie erstellt wurden.

- Bei der Erstellung von Kandidat*innen gibt es nun einen Button “Speichern & Neu”, mit dem direkt die/der nächste Kandidat*in erstellt werden kann.

Euer Wunsch-Feature ist dabei, ihr seid absolut begeistert, aber noch keine Applysia-User*innen?

Dann meldet Euch gerne bei uns und wir vereinbaren eine kostenlose und unverbindliche Demo. Wir zeigen Euch, wie unsere Software funktioniert und welchen Mehrwert Applysia für Euren Personal-Prozess bietet. Außerdem beantworten wir gerne all Eure Fragen. Füllt dafür einfach das Formular unten auf unserer Website aus!