Mara Santidrián Korff

•9 März 2022

Mehr sprechen, weniger testen – Warum Interviews in der Personalauswahl in den Vordergrund rücken

Noch besser, noch simpler, noch genauer. Ein messfehlerfreier Test, der ausschließlich das misst, was gemessen werden soll und auch noch eine hohe Vorhersagekraft besitzt, ist wohl der Anspruch aller HRler*innen und zugleich die reinste Utopie. So endet das Streben nach dieser Perfektion häufig in Frustration. Außer man rechnet sich die Perfektion zurecht. So könnte man Ergebnisse von Schmidt und Hunter (1998) vor dem Hintergrund der zuletzt erschienenen Revision von Sackett et al. (2021) provokant deuten.

Die Metaanalyse von Schmidt und Hunter (1998) gilt als der Goldstandard für die Einschätzung der Gültigkeit von Personalauswahlinstrumenten. Seit der Veröffentlichung stützen HRler*innen ihre Entscheidungsfindungsprozesse auf diese Ergebnisse. Nun haben Sackett und Kollegen (2021) diese Metaanalyse untersucht und fanden erhebliche Ergebnisunterschiede, die die Gültigkeit häufig verwendeter HR-Instrumente in Frage stellen könnten.

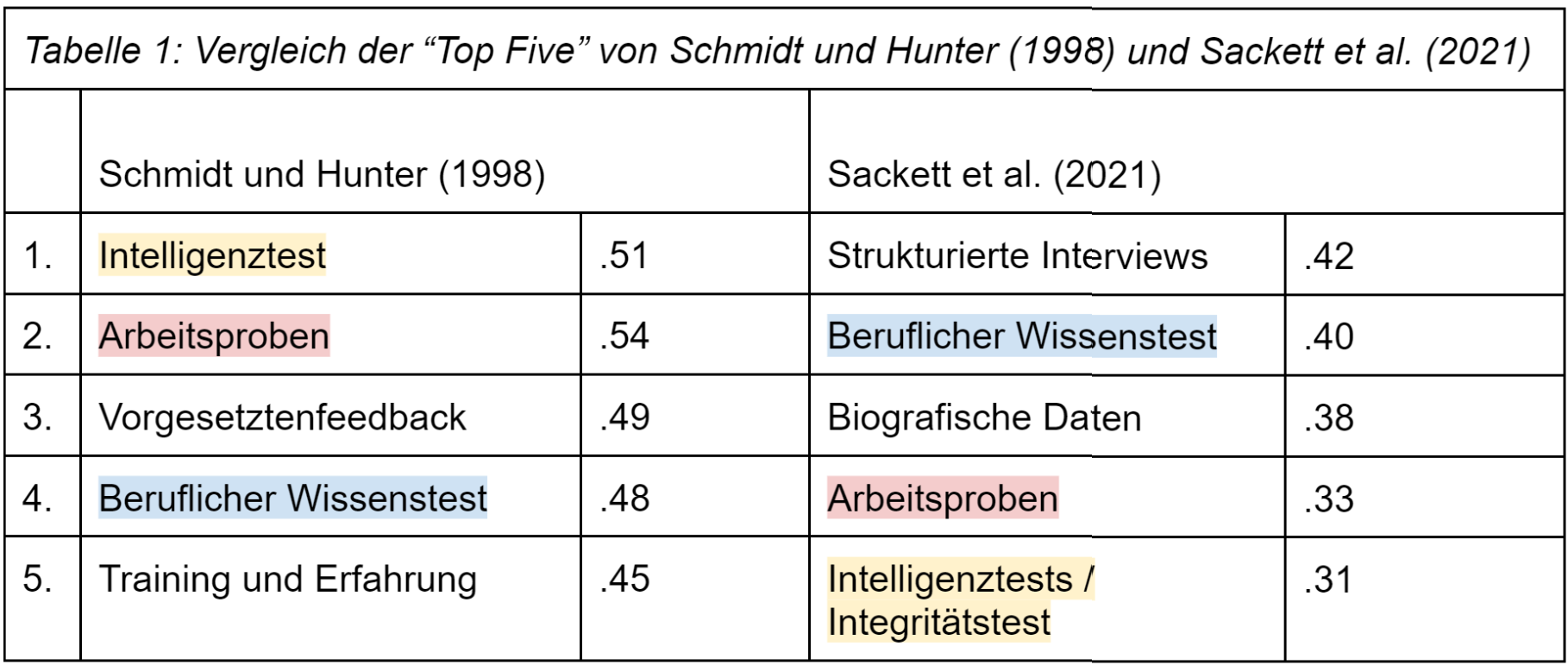

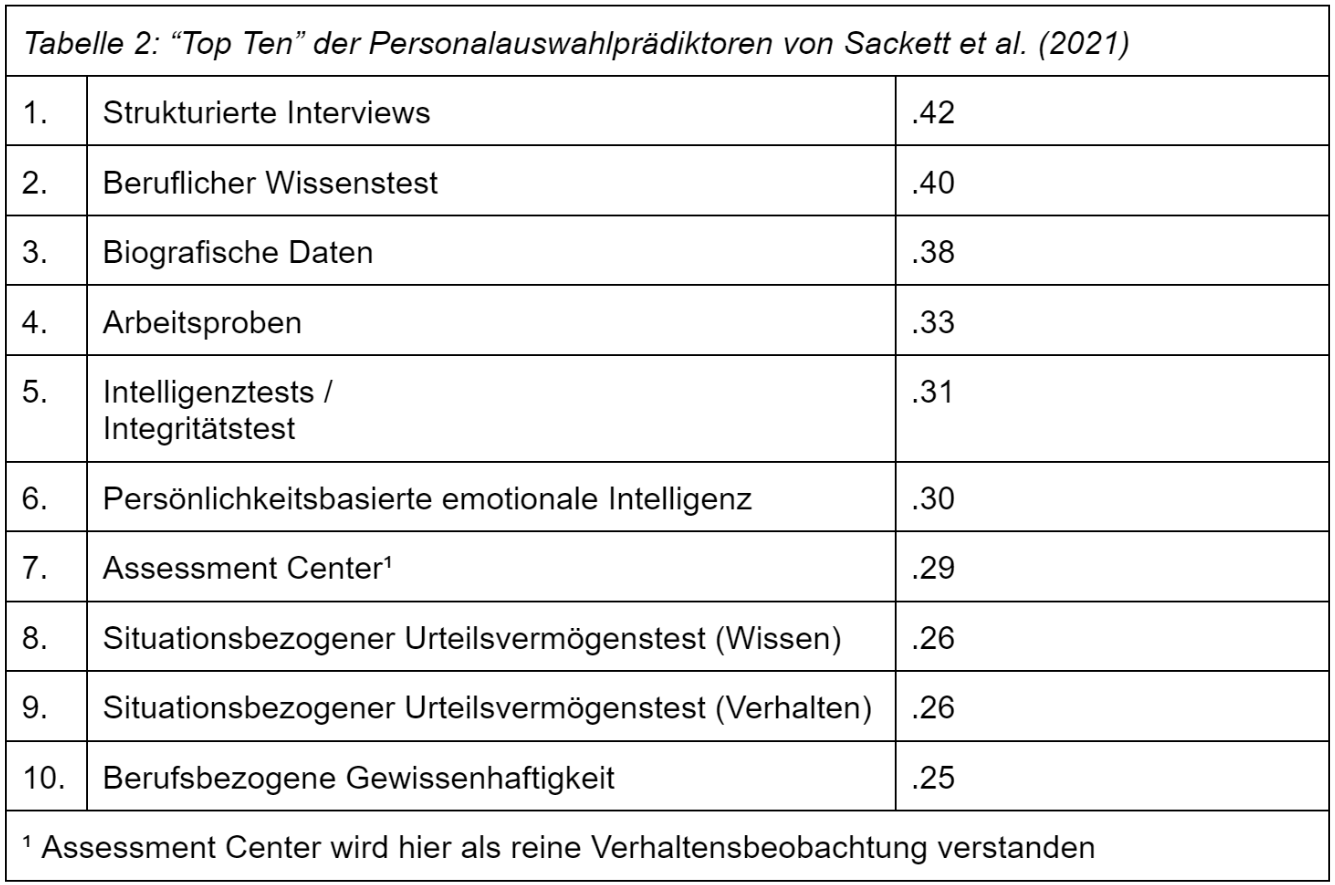

(Für alle, die sich einen Überblick über die Ergebnisse verschaffen wollen: Wir haben unten zwei Tabellen zusammengestellt. Tabelle 1 vergleicht die Ergebnisse der zwei Studien und Tabelle 2 listet die “Top 10 Personalauswahlinstrumente” von Sackett et al. (2021) auf.)

Schmidt und Hunter (1998) nahmen Intelligenztests als Basis für die Vorhersage von Berufserfolg und untersuchten, wie gut jede weitere Methode bzw. jedes weitere Instrument zusätzlich Berufserfolg vorhersagen kann. Als wichtigstes Ergebnis fanden sie heraus, dass Intelligenz am besten für die Vorhersage von beruflicher Leistung geeignet ist. Folglich wurden Intelligenzmessverfahren als Auswahlinstrument empfohlen und Kandidat*innen häufig aufgrund ihrer Intelligenzmessung eingestellt bzw. abgelehnt. Ein Update von Schmidt et al. (2016) bestätigt Intelligenz als besten Prädiktor für Berufsleistung, jedoch weisen die Ergebnisse der untersuchten Auswahlinstrumente erheblich höhere Werte auf als zuvor.

Diese Unterschiede lassen sich durch sogenannte “überkorrigierte range restrictions” erklären. Klingt kompliziert, ist auch so: Hintergrund ist die Tatsache, dass kein Test zu 100 % fehlerfrei misst. So ist es üblich, dass um die Fehleranteile jeder Methode korrigiert wird, um möglichst genau das Merkmal zu messen, was im Vordergrund steht (z.B. Intelligenz). Range restrictions beschreiben eine Varianzeinschränkung auf dem Prädiktor (hier z.B. Intelligenz) und/oder dem Kriterium (hier Berufserfolg), z.B. ein Mindestwert an Intelligenz als Anforderung für die Einstellung. Wird also zu viel korrigiert, können die Ergebnisse überschätzt und einer Methode zu hohe “aufgeblasene” Korrelationswerte zugeschrieben werden. Das führt dazu, dass einem Instrument dadurch eine künstlich erhöhte Vorhersagekraft für Berufserfolg zugeschrieben wird.

Daraufhin haben Sackett und Kollegen (2021) sich mit der Metaanalyse beschäftigt und die Überkorrektur analysiert. Durch eine Minimierung der Fehler der Korrektur haben sie mit ihrer Analyse wahrscheinlich eine realistischere Einschätzung der Gültigkeit von Auswahlinstrumenten geben können (siehe Tabelle 1).

Aus ihrer Analyse können vier Hauptergebnisse abgeleitet werden:

Intelligenztests weisen übergreifend geringere Validitäten auf.

- Den einzelnen Methoden werden übergreifend geringere Validitäten (Gültigkeit) zugeschrieben. Teilweise lassen sich Unterschiede in der Validität von bis zu .21 identifizieren. Sackett et al. (2021) sehen zwar Intelligenztests weiterhin als einen guten Prädiktor für späteren Berufserfolg, weisen jedoch deutlich niedrigere Werte vor, als Schmidt (2016) und Schmidt und Hunter (1998) (r = .51 vs. r = .31).

Der Erklärungsbeitrag von Intelligenztests wurden jahrelang überschätzt.

- Konkret versteht man unter “erklärter Varianz” den Anteil an Streuung in der Variable, an der wir interessiert sind, der tatsächlich durch den Test erklärt werden kann und nicht durch alternative Störfaktoren (z.B. Stimmungslage). Laut Schmidt und Hunter (1998) kann ein Intelligenztest zu 25 % (r = .51) der Varianz im späteren Berufserfolg vorhersagen, d.h. wie erfolgreich jemand in seinem Beruf ist, ist zu einem Viertel durch seine Intelligenz erklärbar. Sackett et al (2021) fanden jedoch heraus, dass nur 9 % des Berufserfolgs (r = .31) tatsächlich direkt auf Intelligenz zurückzuführen ist. Die Vorhersagekraft von Intelligenztests könnte demnach jahrelang überschätzt worden sein, da die tatsächliche Gültigkeit deutlich geringer ausfällt.

Der Grad der Strukturierung eines Interviews hat erhebliche Auswirkungen auf die Vorhersagekraft.

- Einen weiteren großen Unterschied fanden sie bezüglich Interviews. Dabei wurde in der Strukturierung der Interviews unterschieden. Hier fanden Schmidt und Hunter (1998) eine Validität von r = .51 für strukturierte und r = .38 für unstrukturierte Interviews. Sackett et al. (2021) hingegen berichten eine Validität von r = .42 bzw. r = .19. So zeigt sich nicht nur eine allgemein niedrigere Validität für Interviews (wie für alle Instrumente im Vergleich zur Studie von 1998), sondern auch weiterhin eine große Differenz zwischen den beiden Interviewmethoden. Der Strukturierungsgrad eines Interviews hat demnach sehr große Auswirkungen auf dessen Qualität und Gültigkeit. Freiräume in der Strukturierung sind zwar möglich und bringen auch Vorteile mit sich (z.B. Natürlichkeit während des Interviews und soziale Akzeptanz), jedoch kann man davon ausgehen, dass eine höhere Strukturierung zu einer höheren Vorhersagekraft führt. So erzielen strukturierte Interviews in der Analyse von Sackett et al. (2021) die besten Werte, um Berufserfolg vorherzusagen.

Die Kombination von Methoden erhöht die Wahrscheinlichkeit einer validen Entscheidungsfindung.

- Einen letzten zentralen Aspekt, den Sackett et al. (2021) thematisieren ist die Kombination mehrerer Methoden. Vor dem Hintergrund der Diskriminierungsgefahr im Einstellungsverfahren sind Personalverantwortliche dazu verpflichtet, alles Mögliche zu tun, damit eine faire Personalauswahl stattfindet. So haben Sackett et al. (2021) herausgefunden, dass drei ihrer “Top Five” Prädiktoren (siehe Tabelle 2) für Berufserfolg gleichzeitig die sind, die erhebliche Unterschiede zwischen “schwarzen und weißen” Probanden aufweisen. Es ist daher auf jeden Fall empfehlenswert einen passenden Mix von Methoden heranzuziehen, um die Diskriminierung zwischen Ethnien limitieren zu können. Zusätzlich ist die Kombination vieler Methoden von Vorteil, da so die Limitation jeder Methode minimiert werden kann und Personalverantwortliche weniger Gefahr laufen ihre Entscheidungen durch den Fehleranteil eines einzelnen Tests oder Instruments zu verfälschen/ beeinflussen. Mehrere kombinierte Methoden können also die Schwächen einzelner Methoden ausgleichen und so eine valide Entscheidungsfindung unterstützen.

Dafür bieten sich hierbei besonders Assessment Center an, die genau solch eine Kombination mehrerer Personalauswahlverfahren beinhalten und Kandidat*innen anhand ihrer Kompetenzen in verschiedenen Übungen bewerten. Bei der Planung, Durchführung und Auswertung von Assessment Centern unterstützt Applysia. Durch unsere digitale Software werden die Prozesse einfacher und personalisiert dargestellt, Daten intuitiv und valide erhoben sowie fair ausgewertet. Mehr Informationen zu digitalen Assessments unter www.applysia.de.